人工智能

人工智能术语解释

人工智能AI工具合集

AI编程插件和IDE

WPS/Office安装AI插件

搭建本地知识库:ima.copilot和pandawiki

Windows使用LM Studio部署DeepSeek R1模型

python调用LM Studio(AI)本地API

AI人工智能第三方API大全

Windows安装CUDA环境

Windows使用LLaMA-Factory微调LlaMA 3大模型

Ubuntu虚拟机部署Dify+Ollama搭建智能体和工作流

通过MCP调用Kali工具

MCP介绍和服务导航

大模型安全相关资料

IDE中kali MCP不能显示和无法连接的问题

Windows安装使用OpenClaw(龙虾)

AI导航站

AI Skill导航网站

Windows安装Ollama本地部署大模型

本文档使用 MrDoc 发布

-

+

首页

Windows安装Ollama本地部署大模型

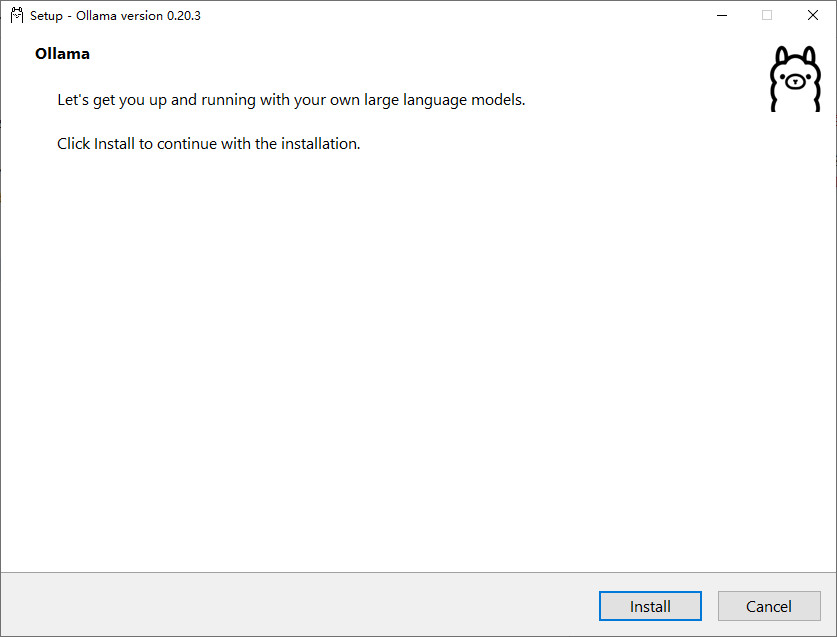

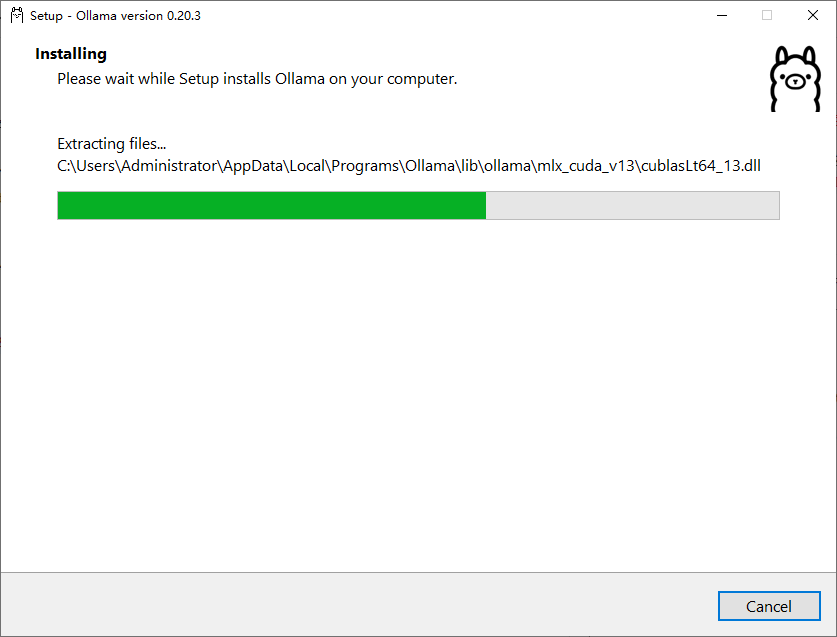

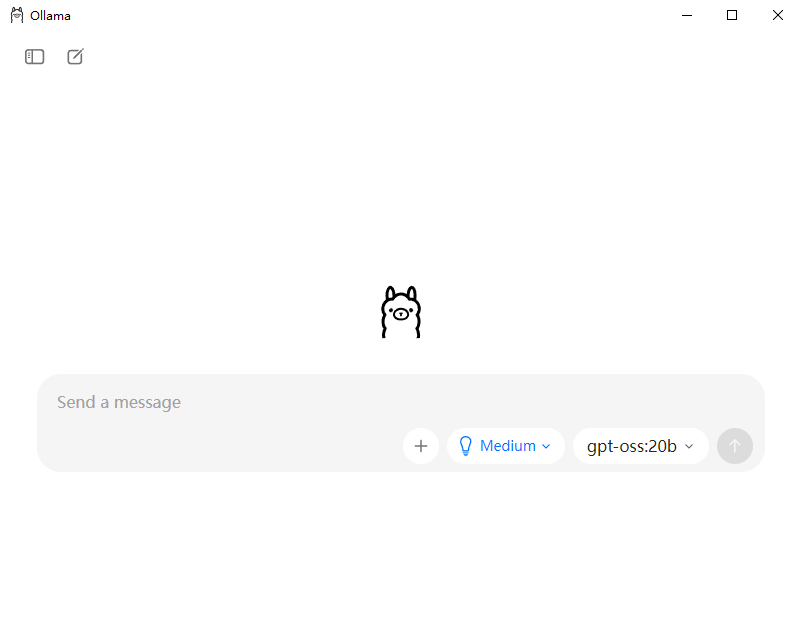

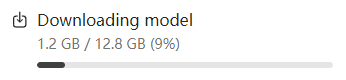

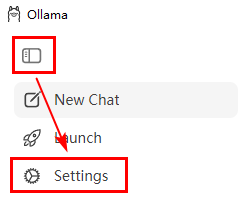

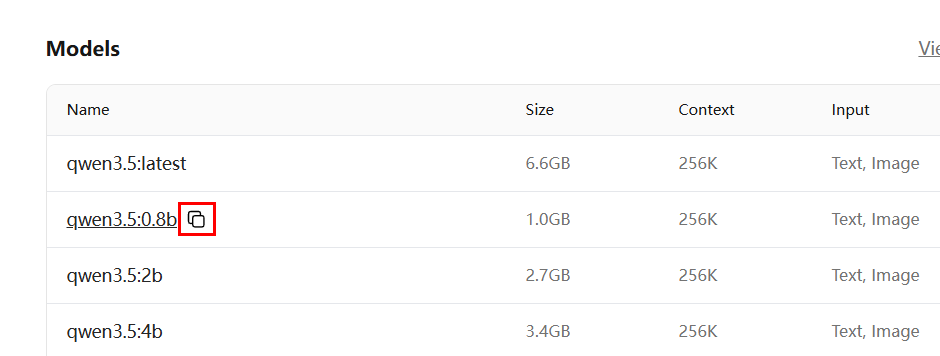

Windows使用LM Studio部署DeepSeek R1模型 https://wiki.bafangwy.com/doc/805/ # 为什么要本地部署大模型? 隐私: 所有的对话都在你本地电脑,不用担心数据被上传。 免费: 不用充值会员,不用买Token,想用多久用多久。 离线: 没网络的地方,依然可以使用。 # 说明 本地部署大模型,当参数数量比较大的时候,对电脑的硬件配置要求比较高,而且效率不如远程的API。 # 注册账号 联网搜索需要登录账号。 也可以使用Google或者Github账号直接登录。 需要绑定邮箱、手机号。 https://signin.ollama.com/ # 下载 建议直接使用迅雷粘贴这个地址下载,这是速度最快的一种方法: `https://ollama.com/download/OllamaSetup.exe` # 安装 ollama默认是安装在C盘的,请确保C盘有足够的空间  安装中:  # 界面  默认使用`gpt-oss:20b`的模型,在聊天时会触发下载 <font color="red">不建议用界面的下载功能,非常慢,而且可能卡住。用后面的命令下载。</font>  # 修改模型存储位置 打开侧边栏,进入设置:  修改模型存储位置,避免占用C盘空间:  # 下载模型 模型下载: https://ollama.com/search 点击模型详情,在具体模型上复制完整名称  然后用`ollama pull 模型名称`命令拉取模型,例如: `ollama pull qwen3.5:0.8b`  在cmd输入`ollama list`查看已经下载的模型列表 在cmd运行交互式的大模型: `ollama run qwen3.5:0.8b` 查看正在运行的模型: `ollama ps` 也可以直接在界面中选择下载的大模型进行对话。 # 启动服务 `ollama serve` Ollama 服务运行在 `http://localhost:11434` 调用本地API参考(修改端口即可): https://wiki.bafangwy.com/doc/806/

八方网域

2026年4月8日 19:29

转发文档

收藏文档

上一篇

下一篇

手机扫码

复制链接

手机扫一扫转发分享

复制链接

如果文档没有解决你的问题,建议把预期结果、命令、错误信息、截图等等发给**AI工具**提问,描述越详细越容易解决

Markdown文件

分享

链接

类型

密码

更新密码